はじめに

スポンサーリンク

自分自身の姿のかわりに、キャラクターの姿で仮想空間に登場させることができる、アバター。

面白そうでやってみたいなーと思っていたので、作ることにしました☺️

やりたいこと:

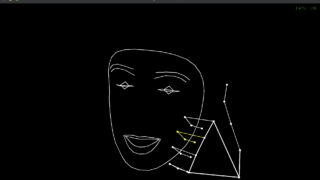

・フェイストラッキングを実装する

・ハンドトラッキングを実装する

・Unityでアバターを動かす

MediaPipeとは

Googleが開発したオープンソースのMLフレームワークです。

顔・手・姿勢などのランドマーク検出が簡単に行えます。

pip install mediapipe顔・手のトラッキング

import cv2

import mediapipe as mp

mp_face_mesh = mp.solutions.face_mesh

mp_hands = mp.solutions.hands

cap = cv2.VideoCapture(0)

with mp_face_mesh.FaceMesh() as face_mesh, mp_hands.Hands() as hands:

while cap.isOpened():

ret, frame = cap.read()

rgb = cv2.cvtColor(frame, cv2.COLOR_BGR2RGB)

face_result = face_mesh.process(rgb)

hand_result = hands.process(rgb)

cv2.imshow('MediaPipe', frame)

if cv2.waitKey(1) == 27:

break

さいごに

それでは、今回はここまで。ありがとうございました😊